احتمالا بارها هنگامی که در مورد مدلهای زبانی بزرگ نظیر ChatGPT، کلاد، لاما، جمینای و … به عبارت Context Window برخورد کردهاید. Context window یا پنجره زمینه یکی از مفاهیم مهم در دنیای هوش مصنوعی به ویژه مدلهای زبانی است. معیاری که با عددهای بزرگ سنجیده میشود و هرچه بزرگتر باشد بهتر است. در این مقاله به این موضوع میپردازیم که کانتکست ویندو چیست و چرا اهمیت دارد.

Context window چیست؟

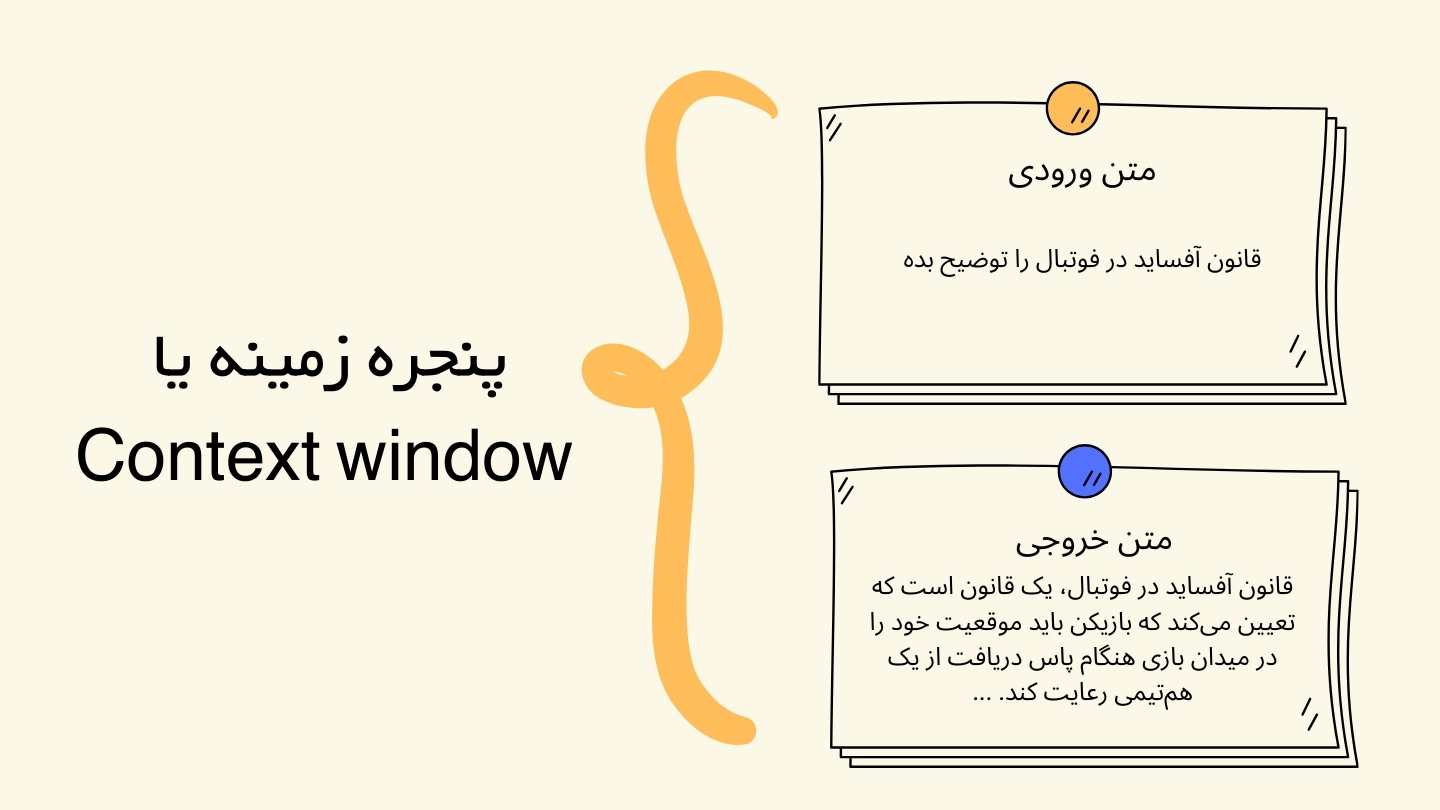

کانتکست ویندو (Context Window) یا “پنجره زمینه” به محدودهای اشاره دارد که یک مدل میتواند به طور همزمان متن ورودی و خروجی را پردازش و به خاطر بسپارد. این محدوده شامل متنهای قبلی و مکالمه جاری میشود و نقش مهمی در فهم مدل از زمینه و ارائه پاسخ مناسب دارد.

احتمالا بارها با این پیام مواجه شدهاید که فایلی را به چت جیپیتی دادهاید و ارور میدهد که فایل را نمیتواند پردازش کند. اینجا همانجایی است که Context window اهمیت پیدا میکند.

Context window به زبان ساده

تصور کنید گفتگویی را با چت جیپیتی آغاز کردهاید. در این گفتگو شما متنهایی را مینویسید یا آپلود میکنید. این متنها را متن ورودی مینامیم. از سویی چت جیپیتی پاسخهایی به شما میدهد. ما این پاسخها را متن خروجی مینامیم. پنجره زمینه محدودیت این پاسخها را با هم شامل میشود. اگر حجم گفتگوی شما، بیش از اندازه مجاز Context window شود، هوش مصنوعی، بخشهای قدیمی تر گفتگو را فراموش میکند.

یا اگر شما در یک پیام، متنی را به هوش مصنوعی بدهید که بیش از اندازه Context window باشد، مدل خطا خواهد دارد. در واقع کانکست ویندو پیمانهای است که میتوان بر اساس آن میزان پردازش متن در یک گفتگو را اندازه گرفت. واحد اندازه پنجره زمینه یا Context window توکن است.

توکن چیست؟

برای درک بهتر کانتکست ویندو، در ابتدا باید با مفهوم توکن (Token) آشنا شویم. توکن در واقع بخشهای کوچکی از متن است که مدل زبان آن را میخواند و پردازش میکند. این بخشها میتوانند کلمات، بخشهایی از کلمات، یا حتی علامتهای نگارشی مانند نقطه یا ویرگول باشند.

برای مثال، کلمه “سلام” یک توکن است، اما کلمه “دوستانه” میتواند به دو توکن تقسیم شود: “دوست” و “انه”. در واقع، توکنها واحدهایی هستند که مدل از آنها برای درک و پاسخ به سوالات استفاده میکند.( توجه، مثال بالا در مورد کلمه سلام و دوستانه تنها یک مثال برای درک بهتر است)

توکنها در هر زبان متفاوت است. به عنوان مثال در زبان انگلیسی، هر کلمه تقریبا یک توکن است، اما در زبان فارسی، هر کلمه گاهی میتواند چند توکن باشد. گاهی هر حرف از یک کلمه میتواند یک توکن باشد. یک مدل هوش مصنوعی در واقع توکنها را پردازش میکند، هرچه تعداد توکنها بیشتر باشد، زمان پردازش و محدودیتها افزایش مییابد. به همین دلیل است که مدلها در زبان انگلیسی سریعتر کار میکنند یا میتوانند پاسخهای بهتر و کاملتری بدهند.

مقاله پیشنهادی: آشنایی با پردازش زبان طبیعی

Context window در مدلهای زبانی مختلف چقدر است؟

Context window با تعداد توکنها شمارش میشود. هرچه این میزان بزرگتر باشد، یعنی مدل میتواند متن طولانیتری را ( چه متن ورودی و چه خروجی) پردازش کند.

مدل زبانی GPT 4o که در چت جیپیتی استفاده میکنیم پنجره زمینهای به اندازه ۱۲۸ هزار توکن دارد. Llama 3.3 نیز مقداری مشابه دارد. و مدلی مثل Gemini 1.5 pro کانتکست ویندو ۲ میلیون توکنی دارد.

به صورت کلی مدلها در تلاش هستند در هر نسخه از خود، پنجره زمینه را افزایش دهند. هرچه پنجره زمینه افزایش یابد، توان مدل در درک و پردازش متنهای طولانیتر بهتر میشود.

چرا پنجره زمینه مهم است؟

کانتکست ویندو در پیمانهای است که یک هوش مصنوعی میتواند بر اساس آن عمل کند. اگر امروزه شما میتوانید یک مقاله ۱۰ صفحهای را خلاصه کنید، یا یک مقاله ۲۰۰۰ کلمهای بنویسید، به لطف اندازههای بزرگ Context window است. همچنین اگر نمیتوانید در یک مرتبه یک کتاب را به صورت کامل بنویسید، یا نمیتوانید یک کتاب را خلاصه کنید، به این دلیل است که هنوز Context window به آن اندازه که باید بزرگ نیست.

آیا چت جیپیتی میتواند یک پاسخ ۱۲۸ هزار توکنی بدهد؟

در بالا گفتیم که کانتکست ویندو مدل GPT-4o برابر ۱۲۸ هزار توکن است. اما این به این معنا نیست که میتواند پاسخی تا این اندازه طولانی برای شما بنویسد.

بسیاری از افراد، به ویژه افرادی که از هوش مصنوعی برای تولید محتوا استفاده میکنند، همیشه به دنبال تولید مقالات طولانیتر و جامعتر هستند. آنها این تجربه را دارند که چت جیپیتی نمیتواند متنهایی در اندازههای طولانی مثل ۳ هزار کلمه یا ۴ هزار کلمه تولید کند.

این موضوع به این بر میگردد که چت جیپیتی میتواند، اما نمیخواهد. در واقع کانتکست ویندو توان را نشان میدهد نه سقف کلمات را. خود چت جیپیتی و البته سایر مدلها، ترجیح میدهند برای حفظ عملکرد بهتر مدل، میزان هر پاسخ را محدود نگه دارند. از همین رو توقع نداشته باشید که چت جیپیتی پاسخی ۱۲۸ هزار توکنی به شما بدهد.

چگونه بهینهتر استفاده کنیم؟

شما به عنوان یک مخاطب میتوانید با درک بهتر کانتکست ویندو، نحوه استفاده خود از مدلهای هوش مصنوعی را بهبود ببخشید. در ادامه برخی از مواردی که میتواند به شما کمک کند را بررسی میکنیم.

انگلیسی بهتر از فارسی است. یک متن انگلیسی، توکنهای کمتری از زبان فارسی دارد. پس وقتی انگلیسی کار میکنید، قدرت مدل بیشتر است. به همین خاطر است که در انگلیسی ممکن است پاسخهای طولانیتری دریافت کنید.

مختصر و مفید بنویسید. نوشتن متن زیادی و غیر ضروری یعنی مصرف توکن بیشتر، پس سعی کنید به اندازه بنویسید و همچنین اطلاعات اضافی درخواست نکنید و بر خواسته اصلی خود تمرکز کنید.

گفتگو را مدیریت کنید. در یک مکالمه، اگر جد گفتگوی شما بیشتر از اندازه پنجره زمینه شود، مدل متنهای ابتدایی را فراموش میکند تا متنهای جدید را جایگزین آن کند. به این موضوع توجه کنید و گفتگوها را به شکلی مدیریت کنید تا پاسخهای با کیفیت تری بگیرید. اگر احساس کردید پاسخهای انتهایی مناسب نیست، بدانید که مدل بخشی از ابتدای گفتگو را فراموش کرده است.

آینده پنجره زمینه در دنیای هوش مصنوعی

پنجره زمینه مدلهای هوش مصنوعی روز به روز بزرگتر میشود. پس طبیعی است که در آینده منتظر مدلهایی با Context window چند میلیونی باشیم. در این صورت شاید شما به راحتی بتوانید در آینده، با هوش مصنوعی یک کتاب بنویسید، یا کتاب را با یک کلیک ترجمه کنید و …

با این وجود باید همچنان منتظر ماند و میزان پیشرفت مدلها را نظاره کرد.